ChatGPTに質問をしても、ある人は30分で企画書を完成させ、ある人は使えない文章しか得られません。この差を生むのは「AI傾聴力」だと言えます。対話でAIの応答をどう受け止め、次の問いをどう返すかという力です。

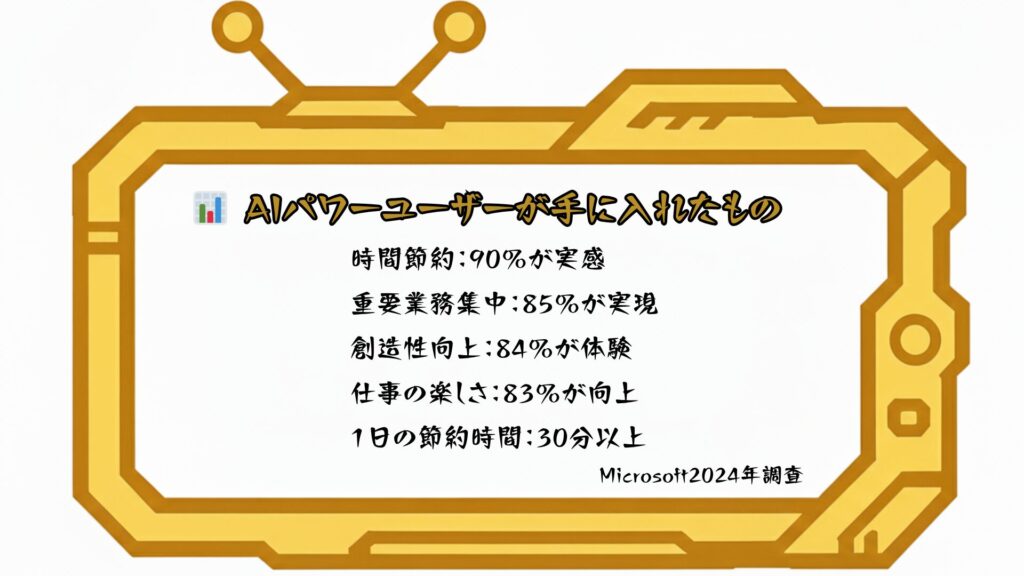

マイクロソフトとLinkedInの2024年の調査では、AIパワーユーザーは1日30分以上の時間を節約し、90%が「創造性が向上した」と回答しています。PwCの調査でも、生成AIの活用によって創造的業務へのシフトや業務効率化が進んでいることが示されており、同様の傾向が見られます。

ところが、「丸投げ」だと思うような効果を得られません。「対話」を意識することに秘訣があります。この記事では、AIとの対話で成果を出す人が実践している3つの判断技術を、具体例とデータで解説します。

導入部参考データ

Microsoft WorkLab|AI at Work Is Here. Now Comes the Hard Part

PwC Japanグループ|生成AIに関する実態調査2024春

AIとの対話は同様でもなぜ成果が10倍違う?

同じLLMを使っても、結果は人によって大きく異なります。ある人は業務時間を大幅に短縮し、ある人は「使えない」と諦めてしまう。この差は技術力ではありません。対話の質が決定的に違うのです。

マイクロソフトの調査によると、現在世界のオフィスワーカーの75%がAIを使用しています。その中でも「パワーユーザー」と呼ばれる人々は、1日30分以上の時間を節約しているそうです。

彼らが手に入れたものは、時間だけではありません。90%が「時間を節約できた」と答えましたが、85%が「最も重要な仕事に集中できた」と回答しています。さらに84%が「創造性が向上した」、83%が「仕事をより楽しめた」と答えているのです。

興味深いのは、パワーユーザーの特徴です。彼らは経営層や責任者からAI活用に関するメッセージを受け取る確率が61%高く、役割に特化したAIトレーニングを受ける確率が35%高いことがわかっています。つまりAI効率化を実感するには、個人の努力だけでなく、組織のサポートも重要だと言えるでしょう。

企業レベルでも同様の二極化が起きています。PwCの調査によると、日本企業の43%が生成AIを活用中ですが、期待を超える成果を出す企業と、期待を下回る企業に分かれ始めました。

成功している企業の共通点は何でしょうか。経営層の関与、適切な投資、そして明確な目的です。最も重要な成功要因として挙げられているのが「ユースケース設定」でした。

ユースケース設定とは、生成AIをどの業務にどう活用するか、具体的に定めることです。これが明確であるほど、導入効果が高まり、成果につながりやすくなります。「とりあえず使ってみる」だけでは、成果は出ないかもしれません。

失敗する企業は、AIを導入すること自体を目的にしてしまいます。他方、成功する企業は異なり、解決したい課題を明確にしてAIをその手段として位置づけているのです。

個人でも同じことが言えるでしょう。「ChatGPTを使ってみよう」ではなく、「この企画書作成にChatGPTを活用しよう」という具体的な目的が必要です。

では、どうすれば成果を出せる使い方ができるのか次のパートで見ていきましょう。

①AIに「想い」を伝える対話設計

「良い企画書を書いて」とLLMに指示を出すと、当たり障りのない文章が返ってきて、結局自分で最初から書き直す。こういった経験は「AIあるある」かも知れません。

現状うまく使えていない人は「AIは完璧に答えるもの」と思い込む傾向があります。だから「良い企画書を書いて」のような曖昧な指示を出してしまいます。使いこなす人の場合だと、AIを対話の相手として、具体的に指示を出すのです。

たとえば「30代女性向け、予算50万円の企画書を3案作って」と指示しただけでは、AIは動けないのです。数字に加えて「意図」と「想い」を伝えるべきです。

たとえば一例を挙げると次のようになります。

30代女性向けのオンライン美容セミナー企画書を3案作成してください。

背景と課題:当社は化粧品ECを運営しています。顧客の75%が30代女性ですが、リピート率30%と低く、LTV向上が課題です。

目的:リピート率を50%に引き上げ、単なる購入者ではなくブランドのファンを育てたい。

ターゲット:忙しい会社員層。時短美容とエイジングケアに悩みながらも、「もう一度、自分らしく輝きたい」と願っています。

予算と形式:総額50万円。3ヶ月連動型セミナー。 第1回=エイジングケア基礎、 第2回=時短美容テクニック、 第3回=コミュニティ形成。

構成要素:各案にテーマ、講師候補、集客方法、予算配分、期待効果、リスク対策を含めてください。

全体コンセプトは「Re:Bloom(再び咲く)」。 参加者が「自分を諦めない」と決める瞬間に、私たちのブランドが寄り添う。 そんな企画にしてください。

命令寄りのものではなく手紙のように綴っていくと、ワンパターンで既視感にまみれた企画書から、一歩跳びぬけた内容が生まるでしょう。

先ほどの例で、単に「企画書を作って」と指示する場合との違いですが、まず背景を伝えています。「顧客の75%が30代女性、リピート率30%」という現状課題の共有です。次に目的を明確にしています。「リピート率50%」という数値目標と、「ファンを育てたい」という本質的な狙いです。

そしてターゲットの心理まで伝えています。「時短美容とエイジングケアに悩みながらも、もう一度自分らしく輝きたい」。この一文があるかないかで、出力結果の差には雲泥の差が出るかも知れません。

最後に、全体コンセプトです。「Re:Bloom(再び咲く)」というブランドメッセージと、「自分を諦めない瞬間に寄り添う」という価値観を伝えることで、AIは単なる情報処理ではなく想いを形にしてくれるでしょう。

自分のビジネスを理解し、そこに熱を込めて伝えれば、AIはその意志を形に変えてくれます。

プログラミングの知識はいりません。必要なのは、「何を実現したいか」という明確さと、「なぜそれをやりたいのか」という理由の温度だけです。AIは冷たい存在ではありません。本当は、人の熱を映す鏡なのです。

この対話設計は企画書だけでなく、あらゆる業務に応用できます。メール作成なら「誰に、何を伝えたいか、どんな関係性か」を伝え、資料作成なら「誰が読むか、何を決めてもらいたいか」を伝えるわけです。

AIとの対話では、自分の思考を言語化する力が重要になります。これは技術スキルではなく、思考スキルといった方が語弊が無いのかも知れません。それは普段の仕事や日常の中で鍛えられる能力です。

②AIの出力を見極める3つのチェック

経済産業省は2023年、「問いを立てる力」と「仮説を立てる力・検証する力」を、生成AI時代に必要な重点スキルとして明記しました。逆に言えば、現状これらの能力が不足しているということに他なりません。

実際、総務省の情報通信白書では「AIにより生成された回答を鵜呑みにする状況が続くと、既存の情報に含まれる偏見を増幅し、不公平あるいは差別的な出力が継続・拡大するリスクがある」と警告しています。

なぜ人はAIの出力を鵜呑みにしてしまうのでしょうか。

その理由は単なる「過信」や「確認不足」だけではありません。もっと深い構造があります。

第1に、AIの言葉が「人間の権威」を模倣しているからです。

AIは自信に満ちた断定口調で、文法的にも破綻なく話します。この流暢さは人間の脳に「知性」と「正確性」を自動的に結びつけさせる効果があります。

つまり我々は決して内容ではなく、AIの語り方に説得される場合があると言えるでしょう。

第2に、検証コストのギャップが考えられます。

AIの回答は数秒で出てきますが、それを検証するには何倍もの時間がかかるのが一般的です。もともと持っている知識をベースに質問したとしても、人間が持つ何倍もの情報量が一気に押し寄せます。

このような場合、人間は認知的省エネ(コグニティブ・エコノミー)を好むため、「まあ合っているだろう」と処理を打ち切ってしまう傾向があります。AIの速度に、人間の慎重さが追いつけないのです。

第3に、責任の外部化です。

人間は責任の所在を曖昧にできる場面で、判断を外部に委ねがちです。AIが間違えた場合、「AIがそう言ったから」という逃げ道に向かってしまうことはあるものです。

AIに伺いを立てる行為は情報判断の外部化であり、それは時に自分自身で追うべき責任をも外に切り離すことにつながるでしょう。

これら3つの構造が重なったとき、AIは誤情報を流暢に話すだけの機械から、確信を与える擬似的権威に変わります。

だからこそAIの出力を疑うことは、単なる間違い探しではなく、自分の思考を取り戻す行為だといって過言はありません。

では、どうすればAIの出力を適切に見極められるのかですが、3つのチェックポイントの実践に秘訣があります。

これらを「当たり前じゃないか、なにをいまさら」と思う人はAIの使い方が非常に優れているのですが、この当たり前を実践している人は驚くほど少ないのです。

まず第1に、一次ソースの確認です。AIが「○○調査によると」と言ったら、その調査レポートを実際に確認してみるのが良いでしょう。URLを尋ね、公式サイトで裏取りをします。存在しないリサーチ元を参照している場合もあるため、この手順は欠かせません。

第二に、クロスチェックです。複数の情報源で照合しましょう。AIの回答だけでなく、検索エンジンで同じテーマを調べ、他の信頼できる情報源と比較します。複数の独立した情報源で一致していれば、信頼性は高まります。

第三に、常識との照合です。明らかにおかしい内容はないか、自分の経験や知識と照らし合わせると、案外情報や論拠に穴があります。数字の桁が違う、トータル数がおかしい、時系列が合わない、論理が飛躍しているなど、こうした違和感を見逃さないことが重要です。

数分で終わる確認作業であっても、やはり面倒なものです。時間に追われ、AIの流暢な回答に安心し、検証を省いてしまいます。

ただ、AIの出力を見極める力は、情報リテラシーそのものだと言えるでしょう。出力された内容を、いわば傾聴する力が、AIと共に暮らすこれからの時代に重視されていくはずです。

③依存と活用の境界線を判断する

どこまで任せて、どこから自分で考えるかという境界線の見極めは、AIとの対話で最も難しいポイントかも知れません。便利だからといってすべてを任せると、思考力は衰え、情報漏洩のリスクを伴います。逆に、AIを使わないことにこだわると、時間を浪費します。

この境界線の判断には、「責任の所在」と「判断の性質」の2つの軸で考えることが役立つでしょう。

情報収集と整理などのリサーチはAIの得意分野であり、任せられる範囲だと明確にしておいて良いでしょう。もっとも、AIによるリサーチは偏りがあり、検索キーワードの上位サイトを盲目的に集めてくる傾向が見られます。

プロンプトやマニュアルを工夫しつつリサーチを深め、信用できる情報を更に要約してもらうといった使い方は、まさにAIと人間のパートナーシップだと言えます。

文章の下書きも任せられます。企画書、メール、報告書の初稿をAIに作らせ自分で修正すれば、ゼロから書くより圧倒的に早く完成します。ここではAIに共有する機密情報を「〇〇」や「◆◆」などで伏せておくと安心でしょう。

一方、人間が判断すべきもので最も重要なのは、最終的な意思決定です。AIは選択肢を提示できますが、決めるのは人間です。例えば投資判断や人事評価などをAIに任せるのはギャンブルに過ぎません。

倫理的判断も人間の領域です。「この表現は人を傷つけないか」「この方法は社会的に許されるか」といった具合にです。AIには倫理観がありません。人としての良心に照らし合わせた判断をすべきです。

顧客との信頼関係に関わることも、AIに任せるようなものではないでしょう。謝罪、感謝、重要な提案など、これらは人間の温度が必要です。AIが書いた文章をそのまま送れば相手は気づくもので、信頼を失うリスクがあります。

AIは道具のように見えて、実は対話の相手ですから、何を言おうとしているのかヒアリングすることが大切なのでしょう。

コメント